MetaVDは、様々な動作認識データセットを関連付けて有効活用するためのメタデータセットです。

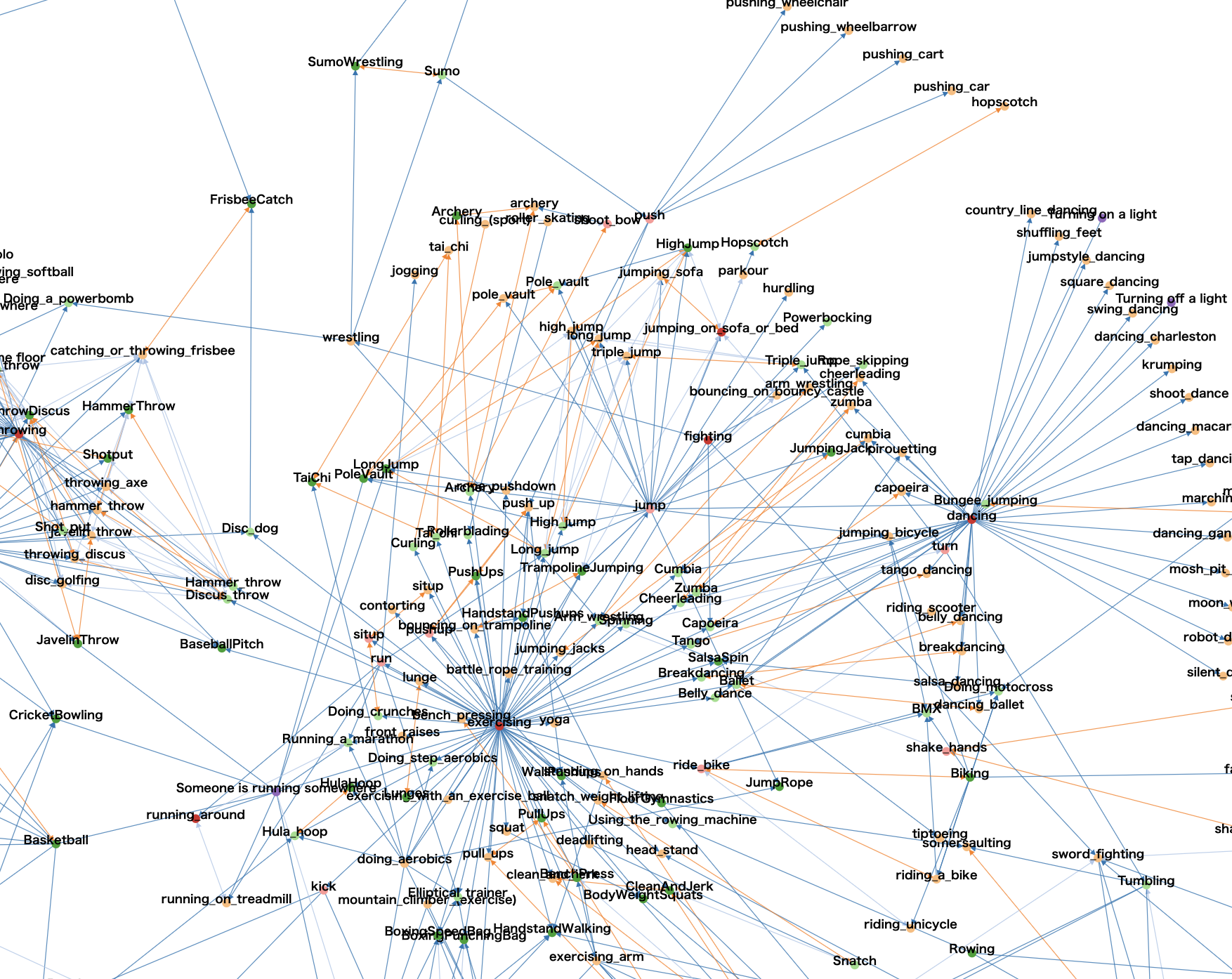

具体的には、各データセットで定義された動作ラベルが表す意味から、

動作ラベル間の意味の同一性や階層性をデータセット横断でアノテーションしたデータを提供します。

MetaVDでは、UCF101, HMDB51, ActivityNet, STAIR Actions, Charades, Kinetics-700が取り込まれています。

今後も増える予定です。

MetaVD is a meta-dataset for utilizing various action recognition datasets by connecting between them.

In particular, MetaVD provides human-annotated relations, such as equality, similarity, and hierarchy, between action labels across the action recognition datasets based on the meaning of the action labels which each dataset defines.

MetaVD v1 contains UCF101, HMDB51, ActivityNet, STAIR Actions, Charades, and Kinetics-700. It will be expanded.